В индустрии больших языковых моделей (LLM) наступил момент, когда простое увеличение количества параметров перестало быть единственным мерилом прогресса. Эпоха «text-only» моделей завершается. С выходом семейства Gemma 4 компания Google DeepMind совершила качественный переход к мультимодальным архитектурам (LMM — Large Multimodal Models), сохранив при этом философию Open Weights.

В этом обзоре мы разберем технические особенности, которые делают Gemma 4 не просто итеративным обновлением, а новой платформой для создания интеллектуальных агентов.

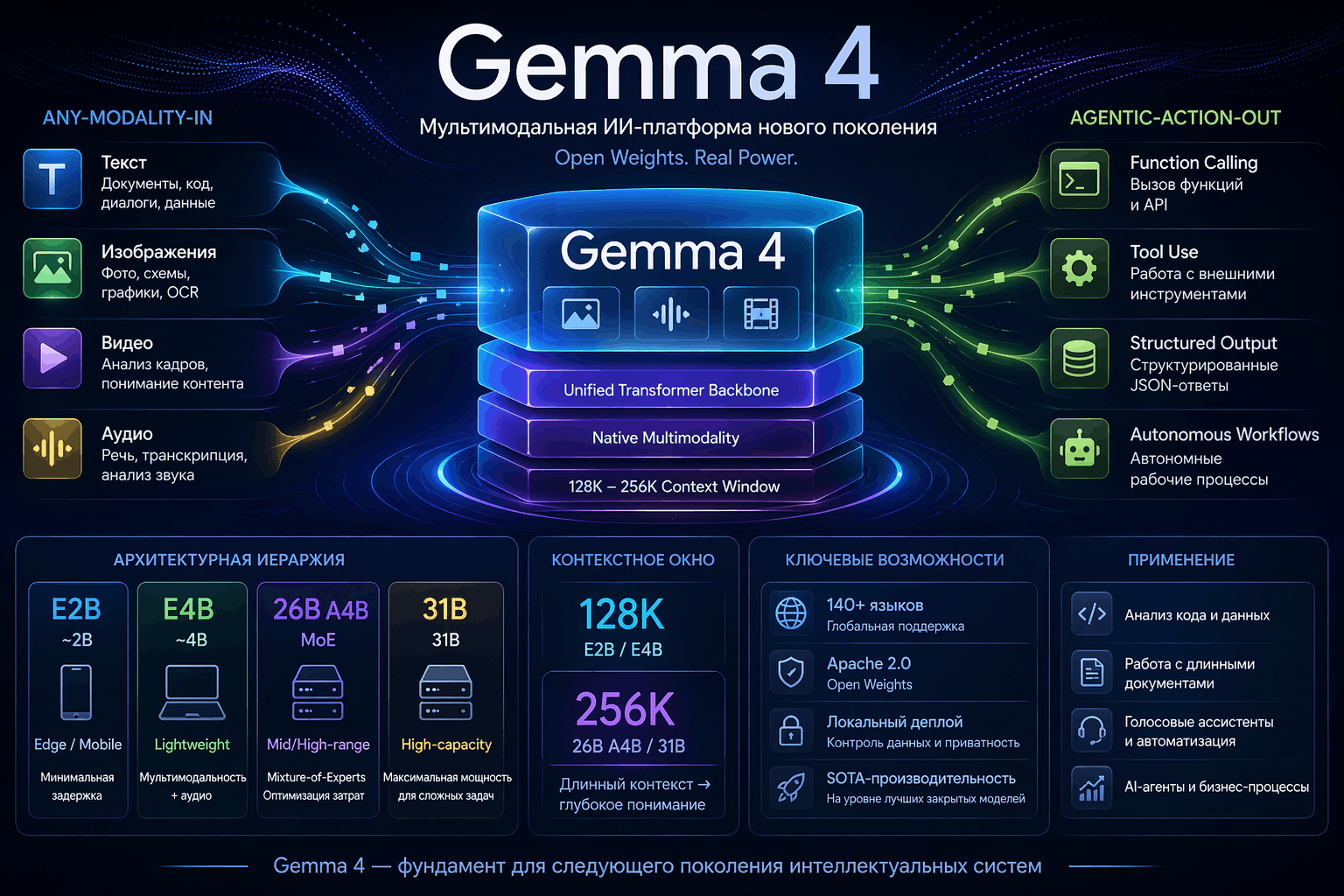

1. Архитектурная иерархия: Баланс между эффективностью и мощностью

Одной из ключевых особенностей Gemma 4 является её иерархическая структура, спроектированная под различные сценарии деплоя — от edge-устройств до высокопроизводительных серверных кластеров.

Модельный ряд включает:

- Ultra-lightweight (E2B / ~2B):

- Оптимизирована для работы в условиях ограниченных вычислительных ресурсов (mobile, IoT). Основной фокус — минимальная задержка (latency) при сохранении базовых рассуждающих способностей.

- Lightweight multimodal (E4B / ~4B):

- Более мощная версия с расширенными мультимодальными возможностями, включая аудио и видео.

- Mid/High-range (26B A4B MoE):

- Смесь экспертов (Mixture-of-Experts), обеспечивающая высокую производительность при оптимизированных вычислительных затратах.

- High-capacity (31B):

- Флагманская модель семейства, ориентированная на сложные задачи reasoning, кодинга и анализа данных.

Такая сегментация позволяет разработчикам гибко подбирать модель под задачу — от edge-инференса до серверных AI-систем.

2. Мультимодальность: интеграция модальностей в рамках одной архитектуры

Gemma 4 изначально проектировалась как мультимодальная система. В отличие от ранних подходов, где мультимодальность реализовывалась как внешний пайплайн (Vision → Text), здесь поддержка разных типов данных встроена в архитектуру семейства моделей.

Важно уточнить: речь не о “магически едином трансформере”, а о интеграции различных энкодеров (vision/audio) в рамках единой модели, что упрощает использование и снижает инженерную сложность.

Vision Capabilities (Зрение)

Модель может обрабатывать изображения и видео, извлекая структурированную информацию и связывая её с текстовым контекстом. Это открывает сценарии:

- анализ схем и интерфейсов

- OCR + понимание контекста

- визуальный QA

Audio-native (E2B / E4B)

Наиболее интересное решение — поддержка аудио в малых моделях (E2B и E4B).

Это позволяет:

- строить голосовых ассистентов с низкой задержкой

- выполнять транскрипцию и анализ речи локально

- создавать edge-решения без облака

3. Расширение контекста: до 256K токенов

Gemma 4 поддерживает длинный контекст, но важно различать:

- E2B / E4B — до 128K токенов

- 26B A4B и 31B — до 256K токенов

Это серьезный шаг вперед по сравнению с предыдущими поколениями.

Практическое применение

- Codebase Analysis

- Возможность загружать большие части репозитория и анализировать архитектуру.

- Document Intelligence

- Работа с длинными документами без агрессивного chunking.

- Снижение зависимости от RAG

- В некоторых сценариях длинный контекст позволяет обойтись без сложной retrieval-инфраструктуры,

- но не заменяет RAG полностью.

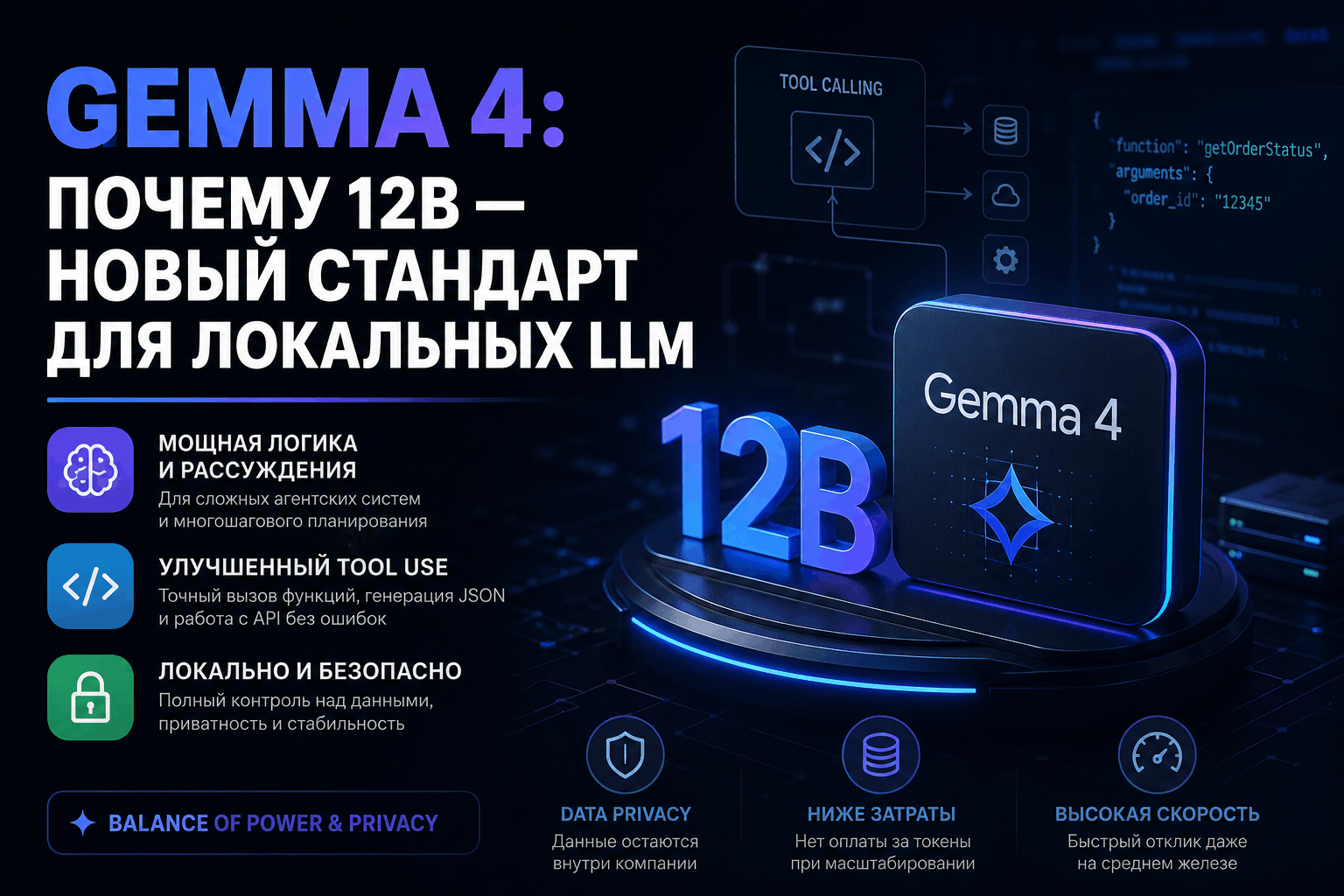

4. Agentic Workflow: Tool Use и Function Calling

Gemma 4 поддерживает:

- Function Calling

- Structured JSON output

- System instructions

Это позволяет использовать модель как оркестратор логики, а не просто генератор текста.

Примеры:

- вызов API (CRM, базы данных)

- выполнение вычислений через внешние сервисы

- автоматизация бизнес-процессов

Для разработчика это означает возможность встроить модель в backend как управляющий слой.

5. Глобализация и доступность

- Поддержка 140+ языков

- Лицензия Apache 2.0 (Open Weights)

Это делает Gemma 4 доступной для:

- локального деплоя

- коммерческих продуктов

- региональных рынков

В отличие от проприетарных моделей, разработчики могут контролировать инфраструктуру и данные.

Заключение

Gemma 4 — это не просто LLM, а переход к парадигме:

“Any-modality-in → Structured / Agentic-out”

Ключевые особенности:

- мультимодальность (текст, изображение, аудио, видео)

- масштабируемость (2B → 31B)

- длинный контекст (до 256K)

- встроенная агентность

Это делает её сильной базой для:

- AI-ассистентов

- автоматизации бизнес-процессов

- локальных AI-систем

Хотите такой же результат?

Бесплатно посчитаем ваш проект и покажем, где автоматизация даст максимальный эффект.

Обсудить проект →

Комментарии · 0