Локальные нейросети уже перестали быть чем-то сложным и экспериментальным. Сегодня это рабочий инструмент, который можно использовать в реальных проектах — без API, без облаков и без лишних затрат.

В этой статье разберём, как запустить AI у себя на компьютере с помощью Ollama и модели Gemma от Google.

Что такое Ollama

Ollama — это инструмент, который позволяет запускать языковые модели локально.

Без сложной настройки.

Без инфраструктуры.

Без лишней боли.

Фактически, это самый простой способ получить локальный AI прямо у себя на машине.

Какие модели можно запускать

Через Ollama доступно несколько моделей:

- Gemma (Google)

- LLaMA

- другие open-source модели

Ты просто выбираешь нужную модель и запускаешь её.

Как запустить локальную модель

После установки Ollama достаточно одной команды:

ollama run gemma4:e4b

Что происходит дальше:

- модель автоматически скачивается

- разворачивается

- запускается

И ты сразу можешь с ней работать.

Интерфейс и работа без консоли

Важно: Ollama — это уже не только консоль.

Есть интерфейс, в котором можно:

- выбирать модели

- искать их

- общаться с ними в формате чата

То есть использовать локальный AI можно даже без навыков программирования.

Как это работает под капотом

Модель загружается на твой компьютер и выполняет все вычисления локально.

Есть три режима работы:

CPU

Работает на любом компьютере, но медленно.

GPU

Значительно быстрее, если есть видеокарта.

Hybrid

Комбинация CPU и GPU — баланс между доступностью и скоростью.

Чем мощнее железо — тем лучше работает модель.

Почему локальный AI — это важно

Использование Ollama даёт несколько ключевых преимуществ:

- ❌ нет оплаты за API

- 🌐 не нужен интернет

- 🔒 полный контроль данных

- ⚙️ можно интегрировать в свои системы

Для разработчиков это особенно важно, если ты работаешь с CRM, автоматизацией или интеграциями.

Где это можно применять

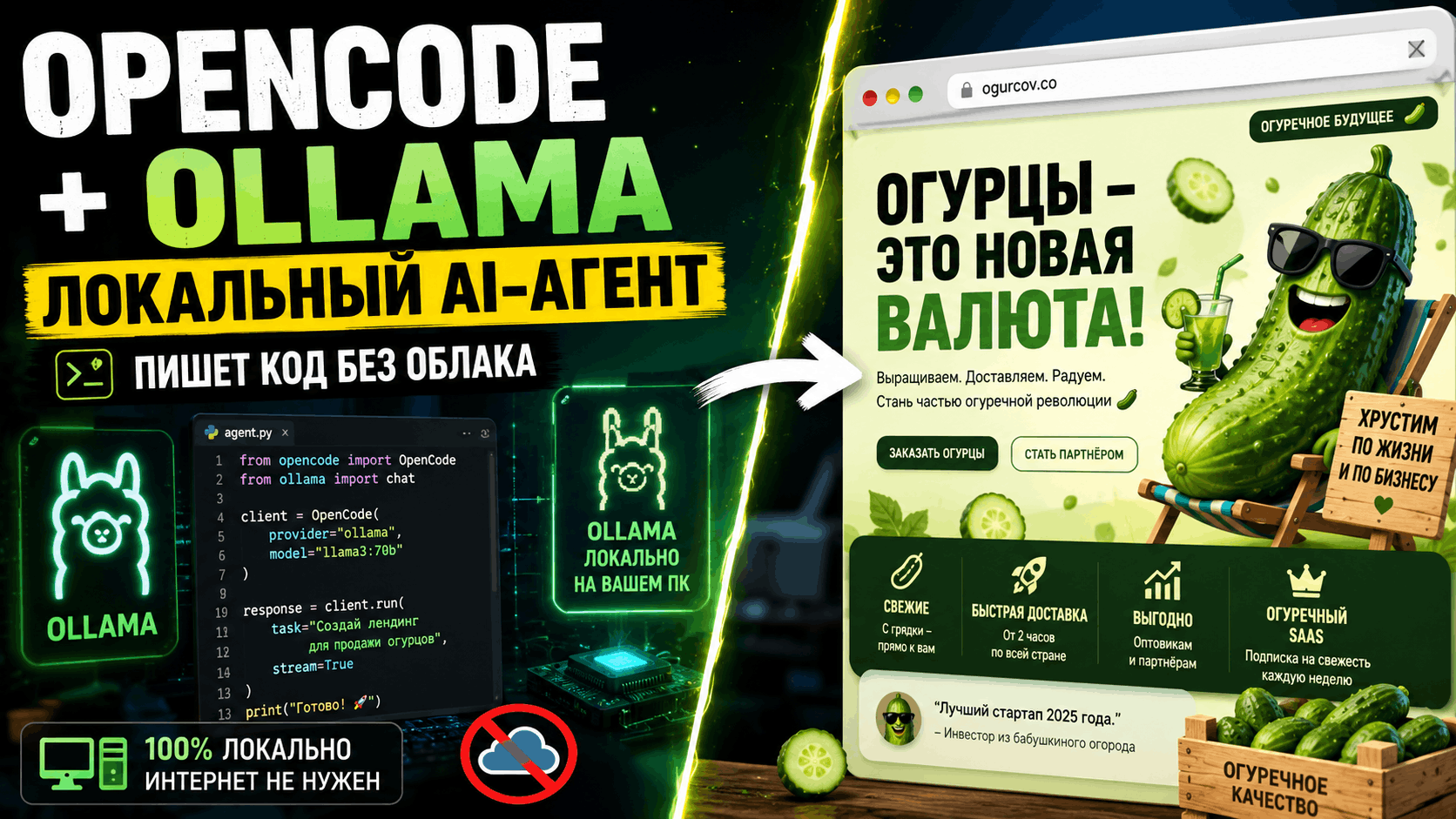

На практике локальные модели можно использовать для:

- генерации кода

- автоматизации бизнес-процессов

- создания AI-ассистентов

- обработки данных

- внутренних инструментов

Итог

Ollama — это самый быстрый способ начать работать с локальными нейросетями.

Ты получаешь:

- полноценный AI

- без внешних сервисов

- с возможностью полной интеграции

И самое главное — это реально можно запустить за несколько минут.

Вывод

Если ты разработчик или занимаешься автоматизацией, локальные модели — это уже не опция, а база.

И чем раньше начнёшь их использовать, тем быстрее сможешь применять их в реальных проектах.

Видео

📺 RuTube:

https://rutube.ru/video/2cf828aac543062885c56f83891b26a4/

▶️ YouTube (альтернатива):

Хотите такой же результат?

Бесплатно посчитаем ваш проект и покажем, где автоматизация даст максимальный эффект.

Обсудить проект →

Комментарии · 0